Khi tội phạm học cách “đóng vai người thân”

Một buổi chiều đầu tháng 9/2025, chị H., nhân viên văn phòng ở Hà Nội, nhận được cuộc gọi video từ con trai du học tại Canada. Màn hình hiện rõ khuôn mặt, giọng nói và cả nụ cười quen thuộc. Cậu con trai nói mình bị tai nạn giao thông, cần chuyển gấp 120 triệu đồng để nộp viện phí. Chưa đầy 10 phút, chị H. làm theo hướng dẫn.

Đến tối, khi gọi lại cho con qua số điện thoại cũ, chị mới biết con trai mình vẫn an toàn. Hình ảnh, giọng nói và cả biểu cảm vừa nãy - tất cả chỉ là sản phẩm của deepfake.

|

| Các đối tượng đã sử dụng công nghệ deepfake nhằm mục đích lừa đảo, chiếm đoạt tài sản. Hình ảnh minh hoạ |

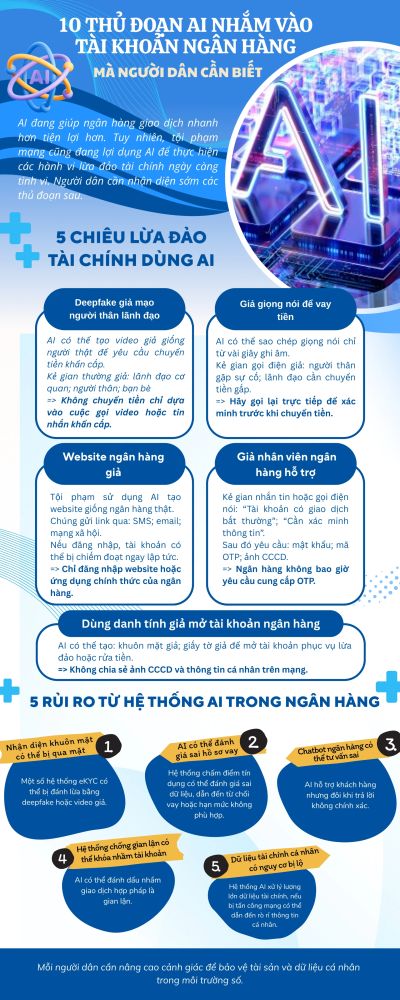

Câu chuyện ấy không còn là cá biệt. Từ đầu năm 2025, Bộ Công an đã ghi nhận hàng trăm vụ lừa đảo sử dụng công nghệ deepfake tại Việt Nam, chiếmđoạt hàng chục tỷ đồng. Đặc biệt, phần lớn nạn nhân là người lớn tuổi, phụ huynh có con đi xa, hoặc doanh nhân thường xuyên giao dịch trực tuyến.

Theo các chuyên gia, các nhóm lừa đảo thường thu thập thông tin từ mạng xã hội, nơi nhiều người công khai hình ảnh, giọng nói, lịch học, thậm chí cả địa điểm đang ở. Từ đó, chúng dựng video giả mạo và gọi điện video qua các ứng dụng phổ biến như Zalo, Messenger, Telegram. Một kịch bản quen thuộc là “giả người thân bị tai nạn”, “giả sếp yêu cầu chuyển tiền gấp”, hoặc “giả nhân viên ngân hàng hỗ trợ tài khoản”.

Một chuyên gia của Cục An ninh mạng (A05, Bộ Công an) cho biết: “Chúng tôi từng ghi nhận trường hợp kẻ gian chỉ dùng 20 giây âm thanh từ video TikTok để huấn luyện AI tạo giọng nói giả, đủ để gọi điện thuyết phục người nhà chuyển tiền.”

Điều đáng nói, công nghệ deepfake hiện đã được thương mại hóa rộng rãi, thậm chí có thể thuê gói “deepfake call” trên các nền tảng ngầm với giá chỉ vài trăm nghìn đồng.

Không ít nạn nhân sau vụ việc rơi vào trạng thái hoảng loạn, cảm giác bị phản bội niềm tin. Nhiều người xóa hết mạng xã hội, sợ hãi mọi cuộc gọi video. Trong một số trường hợp, tội phạm còn sử dụng deepfake để tống tiền hoặc bôi nhọ danh dự, đặc biệt với người nổi tiếng hoặc doanh nhân.

Về pháp lý, Việt Nam hiện đã có Luật An ninh mạng (2018) và Nghị định 53/2022, quy định rõ việc giả mạo, xuyên tạc, phát tán thông tin sai sự thật đều có thể bị xử lý hình sự. Tuy nhiên, việc nhận dạng deepfake vẫn là thách thức vì công nghệ ngày càng tinh vi, khó phân biệt bằng mắt thường.

Deepfake - công nghệ hai mặt

Deepfake là sự kết hợp của “deep learning” (học sâu) và “fake” (giả mạo), dùng trí tuệ nhân tạo để tạo ra hình ảnh, giọng nói và video giống thật đến mức đánh lừa được cả người thân. Chỉ cần vài chục giây ghi âm hoặc vài tấm ảnh đăng trên mạng xã hội, công cụ AI có thể tái tạo khuôn mặt, giọng nói, thậm chí cả cảm xúc của một người cụ thể.

Ban đầu, deepfake được ứng dụng trong điện ảnh, giải trí, giáo dục – giúp tái hiện nhân vật lịch sử, tạo trợ lý ảo, lồng tiếng phim đa ngôn ngữ. Nhưng khi công nghệ rơi vào tay tội phạm mạng, nó trở thành vũ khí tinh vi cho các vụ lừa đảo và tống tiền.

Tổ chức Interpol cảnh báo rằng đến năm 2026, các vụ lừa đảo sử dụng deepfake có thể gây thiệt hại hơn 25 tỷ USD toàn cầu. Tại Mỹ, một tập đoàn năng lượng lớn bị thiệt hại 243.000 USD sau khi kế toán nhận cuộc gọi từ “giám đốc điều hành” yêu cầu chuyển tiền, giọng nói và khuôn mặt hoàn toàn khớp với người thật. Còn ở Trung Quốc, một doanh nhân mất gần 1,4 triệu USD vì tin vào video giả mạo người bạn cũ.

Các quốc gia phát triển đã bắt đầu có biện pháp: Liên minh châu Âu (EU) yêu cầu video do AI tạo phải có nhãn cảnh báo “AI-generated”, trong khi Mỹ xây dựng đạo luật “AI Transparency Act” để buộc các nền tảng gắn dấu nhận diện deepfake.

Làm sao nhận biết và phòng tránh

Chuyên gia an ninh mạng khuyến nghị 5 bước cơ bản giúp người dân tự bảo vệ trước nguy cơ deepfake.

Thứ nhất, không chuyển tiền qua video call nếu chưa xác minh bằng kênh khác (gọi lại số cũ, hỏi qua người quen).

Thứ hai, hạn chế đăng tải hình ảnh và video cá nhân công khai - càng ít dữ liệu, AI càng khó học.Thứ ba, kiểm tra dấu hiệu bất thường: video có thể hơi giật, ánh sáng da không tự nhiên, miệng nói lệch nhẹ so với âm thanh.

Thứ tư, sử dụng phần mềm xác thực khuôn mặt thật (liveness detection) nếu làm việc trong môi trường yêu cầu nhận diện người dùng.

Thứ năm, báo ngay cơ quan chức năng nếu nghi ngờ bị giả mạo, để kịp thời ngăn chặn việc lan truyền hoặc lừa đảo tiếp theo.

Bên cạnh đó, các nền tảng mạng xã hội cũng cần tăng cường công cụ phát hiện video giả. Nhiều hãng công nghệ quốc tế đang thử nghiệm hệ thống truy vết hình ảnh AI bằng mã kỹ thuật số (digital watermark).

Ở Việt Nam, các doanh nghiệp công nghệ cần tham gia tích cực hơn trong việc xây dựng cơ sở dữ liệu nhận diện deepfake, kết nối với Bộ Công an và cơ quan liên quan để kịp thời xử lý.

Deepfake đặt ra câu hỏi lớn cho xã hội hiện đại: khi hình ảnh, giọng nói và cảm xúc đều có thể bị sao chép, điều gì còn thật? Câu trả lời không chỉ nằm ở công nghệ, mà ở thái độ cảnh giác của mỗi người. Tin tưởng nhưng phải kiểm chứng, chia sẻ nhưng phải biết giới hạn – đó là kỹ năng sống còn trong thời đại AI.

Với tốc độ phát triển của trí tuệ nhân tạo, ranh giới giữa thật và giả sẽ ngày càng mờ. Nhưng niềm tin không thể bị lập trình. Và chỉ khi mỗi cá nhân đủ tỉnh táo, chúng ta mới không trở thành nạn nhân trong thế giới ảo đầy cạm bẫy này.

Đạt Dương

Bình luận